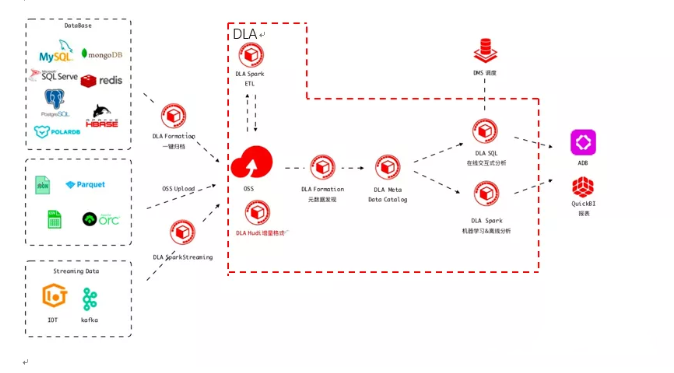

DLA还有一个重要能力是构建了一个“四通八达”的数据流动体系,并以数据库的体验对外提供能力,无论数据在云上还是云下,无论数据在组织内部还是外部;借助数据湖,各个系统之间的数据不再存在壁垒,可以自由的流进流出;更重要的是,这种流动是受监管的,数据湖完整的记录了数据的流动情况。

ActionTrail日志清洗

DLA提供ActionTrail日志自动清洗解决方案,可以将ActionTrail投递到OSS的日志文件转换为DLA中可以直接查询的数据表,同时自动对数据进行分区和压缩,方便您分析和审计对云产品的操作。

日志分析痛点

操作审计ActionTrail是阿里云提供的云账号资源操作记录的查询和投递服务,可用于安全分析、资源变更追踪以及合规性审计等场景。您可以通过ActionTrail控制台,查看各个云产品的操作日志。对于30天以内的日志,ActionTrail支持投递到日志服务SLS进行分析;对于30天以外的数据可以投递到OSS上,但直接分析OSS中的数据有以下痛点。

日志数据格式复杂,不利于直接分析。

ActionTrail中保存的是JSON格式的数据,一行内有多条数据,数据以一个Array的形式保存,例如[{"eventId":"event0"...},{"eventId":"event1"...}]。

理论上可以分析上述格式的JSON数据,但非常不便,需要先把每行数据拆分成多条记录,然后再对拆分后的记录进行分析。

小文件多,分析数据耗时且占用大量系统资源。

当您通过账号(阿里云账号和RAM子账号)频繁操作云产品时,每天产生的操作日志文件数非常多。以操作DLA的帐号为例,该账号下每天会产生几千个数据文件,一个月的文件数将达到几十万个,大量的数据文件对大数据分析非常不便,分析数据耗时,且需要足够大的集群资源才能进行大数据分析。

前提条件

使用ActionTrail日志清洗之前,您需要按照以下步骤做好准备工作。

注意:使用ActionTrail日志清洗功能时,要求ActionTrail、OSS、DLA所属Region相同,否则无法使用该功能。

ActionTrail

在ActionTrail中创建跟踪,请参见创建跟踪。

OSS

开通OSS服务,请参见开通OSS服务。

创建Bucket,请参见创建Bucket。

新建文件夹,请参见新建文件夹。

根据业务需求,判断是否需要新建文件夹,将ActionTrail投递过来的数据存储在新建文件夹中。

DLA

开通DLA服务,请参见 开通DLA服务。

初始化DLA数据库主账号密码,请参见 初始化DLA数据库主账号密码。

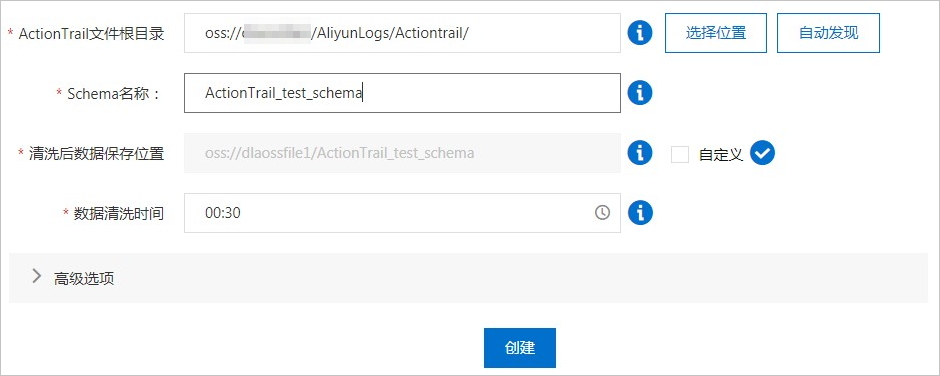

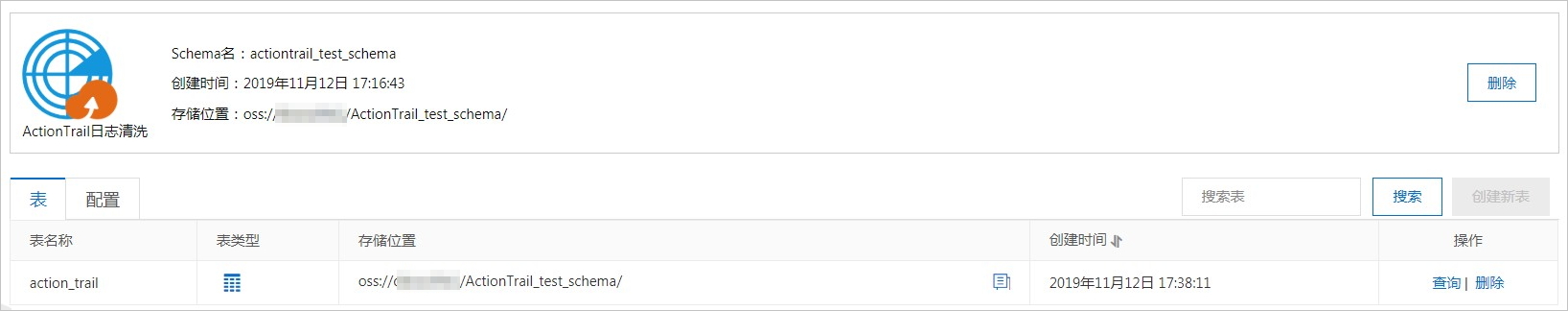

步骤一:创建Schema

登录Data Lake Analytics管理控制台。

在页面左上角,选择DLA所在地域。

单击左侧导航栏的数据湖构建 > 数据入湖,在数据入湖页面单击ActionTrail日志清洗中的进入向导。

在ActionTrail日志清洗页面,根据页面提示进行参数配置。